IA Act : 10 étapes pour s’y conformer efficacement

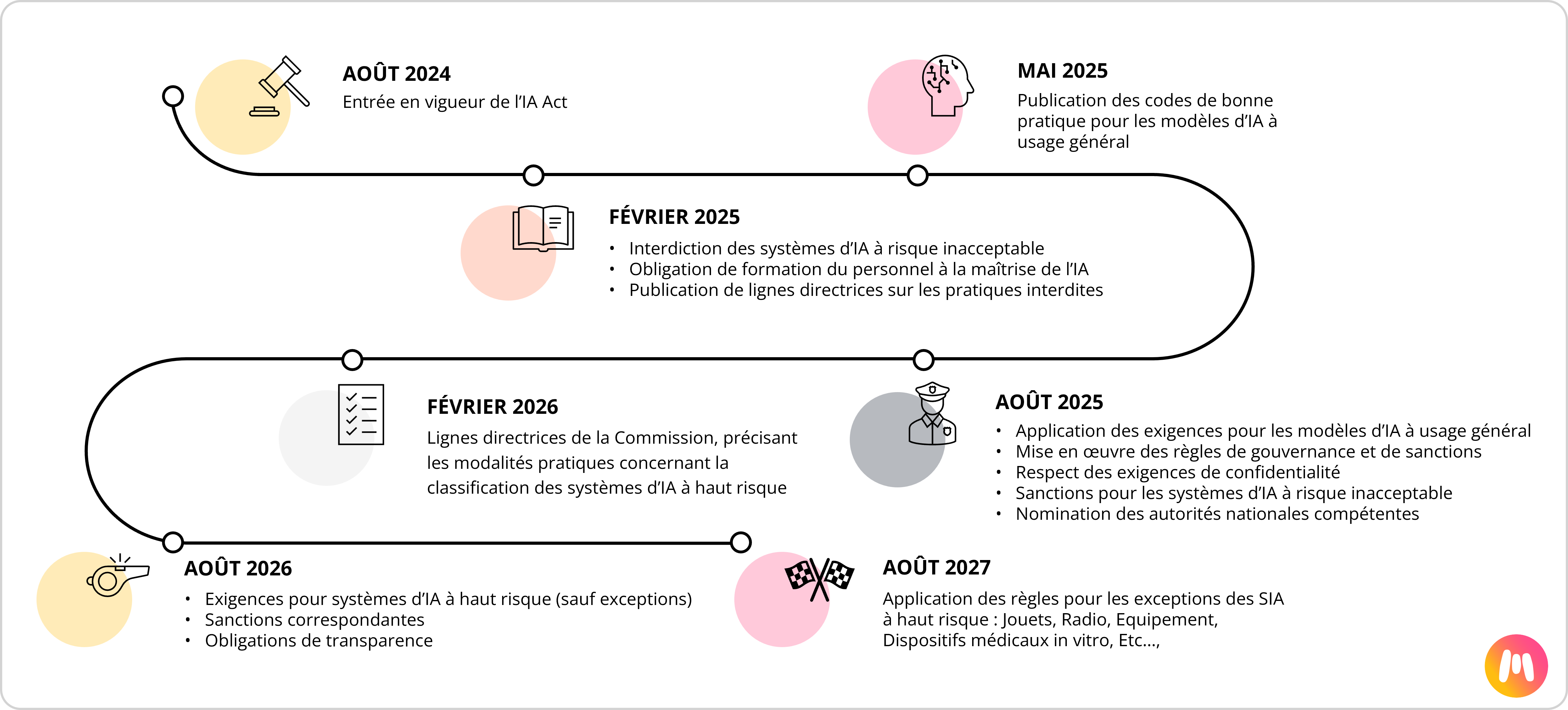

L’Artificial Intelligence Act (AI Act) est le premier cadre réglementaire européen dédié à l’intelligence artificielle. Entré en vigueur en juin 2024, il marque une étape clé dans la conformité IA Act pour les entreprises européennes, avec un déploiement progressif jusqu’en 2027.. Il impose des obligations spécifiques aux entreprises selon le niveau de risque associé à leurs systèmes d’IA : inacceptable, élevé, limité ou minimal. Dès août 2025, certaines exigences deviendront opposables, notamment l’interdiction des IA à risque inacceptable, les obligations de transparence et les exigences sur la formation des personnels.

Il est donc crucial d’initier sans attendre une démarche de mise en conformité, même dans un contexte où certaines lignes directrices sont encore attendues. Les entreprises doivent se mettre en ordre de marche dès maintenant. L’anticipation est stratégique : retard = risque juridique, réputationnel, mais aussi perte de compétitivité.

1. Cartographier vos usages d’IA

La première étape consiste à recenser tous les systèmes IA utilisés dans votre entreprise :

- Finance : scoring, détection de fraude.

- Industrie : maintenance prédictive, automatisation de process.

- Service client : chatbots, recommandation produit.

- Processus RH : Sélection des CV, gestion des rémunérations…

- Etc.

Etablir une cartographie permet de positionner chaque cas d’usage dans les catégories de risque définies par l’IA Act :

- Interdits (ex. manipulation cognitive, notation sociale).

- Haut risque (RH, santé, sécurité).

- Risque limité (ex. chatbots devant informer l’utilisateur qu’il parle à une IA).

- Risque minimal (ex. filtres anti-spam).

Besoin d’aide pour cartographier vos usages IA ? Nos experts peuvent vous accompagner à structurer cette première étape clé.

2. Écarter les pratiques interdites

Certaines applications sont désormais prohibées : notation sociale, extraction non ciblée d’images faciales, reconnaissance biométrique en temps réel dans les espaces publics sans autorisation spécifique, systèmes d’évaluation des émotions à l’école ou au travail. Toute organisation doit vérifier qu’aucun de ses usages actuels ne tombe dans cette catégorie.

3. Identifier les systèmes à haut risque

Une fois vos systèmes identifiés, il faut prioriser vos efforts. Les systèmes à haut risque concentrent l’essentiel des obligations : documentation, robustesse, gouvernance stricte.

Exemples : Un outil de recrutement automatisé tombe dans le périmètre “haut risque”. Un chatbot marketing est classé “risque limité”.

Votre roadmap doit donc commencer par les cas d’usage critiques, sans pour autant négliger les autres. Sont considérés comme à haut risque : Les systèmes utilisés dans l’éducation, l’emploi, l’accès aux services essentiels, la justice ; Certains composants de sécurité soumis à d’autres réglementations européennes ; Dans la finance, l’évaluation de la solvabilité ou la tarification en assurance santé et vie : ces cas nécessitent un plan de conformité prioritaire.

La nouvelle règlementation implique, en fonction des usages IA, de surveiller les biais « éthiques » et « sociétaux ». Il n’existe pas de référentiel des biais. Il s’agit donc de prioriser la mise en conformité en fonction des usages et de la criticité des types de biais.

Exemple de typologie des biais Ai Act dans le domaine de bancaire

|

A titre d’exemple, le domaine bancaire et les processus d’octroie de crédit font l’objet d’une attention particulière. Cela implique, par exemple, pour les systèmes IA, la mise en œuvre dans l’analyse de solvabilité ou dans le calcul de score de crédit, d’élaborer un référentiel des biais pour aider les équipes de modélisation dans la mise en conformité.

4. Appliquer les obligations haut risque

Les fournisseurs (ceux qui développent ou entraînent des systèmes d’IA) doivent notamment : Mettre en place un système de gestion des risques, assurer une gouvernance des données de qualité, documenter techniquement les modèles, garantir supervision humaine, robustesse et cybersécurité.

Les déployeurs (ceux qui intègrent les IA dans leurs processus) doivent utiliser ces systèmes conformément aux instructions, conserver certains journaux et, dans certains cas, réaliser une analyse d’impact sur les droits fondamentaux.

5. Traiter le cas des modèles GPAI

Les GPAI (modèles à usage général) présentant un risque systémique sont soumis à des tests et obligations renforcés.

Les GPAI, comme les grands modèles de langage, doivent être documentés, respecter le droit d’auteur, publier un résumé des données d’entraînement et fournir des informations aux intégrateurs.

6. Intégrer la conformité à l’IA Act dans votre gouvernance

La conformité IA Act doit s’articuler avec le RGPD et les dispositifs existants de gestion des données. En France, la CNIL recommande de coordonner l’analyse d’impact IA Act avec l’analyse d’impact RGPD, et d’impliquer juridiques, DPO, data, métiers et IT dans un dispositif de gouvernance clair.

Elle ne peut pas reposer sur une seule direction. Elle doit être intégrée dans une gouvernance claire, impliquant : Les managers juridiques et risques (interprétation du règlement), les DSI/CDO (gestion des données et infrastructures), les métiers et RH (spécification des cas d’usage), l’innovation (opportunités business).

Plusieurs modèles existent : centralisé, fédéré ou intégré dans une approche DevOps/MLOps. Le choix dépend de la taille et de la culture de votre organisation.

JEMS aide les organisations à intégrer la conformité IA Act dans leur gouvernance Data & IA, avec une approche claire et pragmatique.

7. Former et sensibiliser vos équipes

La conformité ne repose pas seulement sur les juristes. Les équipes métiers, RH, data scientists et responsables IT doivent comprendre les nouvelles obligations. Des formations spécifiques par secteur (santé, finance, industrie) facilitent l’adoption opérationnelle.

8. Anticiper les contrôles

La supervision sera assurée par des autorités nationales de surveillance du marché et par un bureau européen dédié. En France, l’ACPR se prépare à jouer un rôle dans le secteur financier. Les entreprises doivent se préparer à produire leur documentation et leurs analyses d’impact en cas de contrôle.

Se préparer dès aujourd’hui avec une grille de maturité réglementaire est un bon moyen d’éviter les mauvaises surprises.

9. Planifier selon le calendrier

L’IA Act suit une montée en puissance :

- février 2025 : interdictions,

- août 2025 : GPAI et autorités,

- août 2026 : obligations haut risque (annexe III),

- août 2027 : obligations supplémentaires (annexe I).

10. Produire et maintenir vos livrables

La conformité passe par des livrables concrets : documentation technique, registres, preuves de robustesse, résumés de données d’entraînement, procédures de transparence pour les utilisateurs finaux. Ces éléments doivent être intégrés aux processus métiers existants et maintenus dans le temps.

L’approche JEMS : PATH2AI COMPLIANCE

Se conformer à l’IA Act peut sembler complexe. Chez JEMS, nous avons conçu PATH2AI COMPLIANCE, un dispositif unique qui combine flexibilité et expertise interdisciplinaire.

- Approche modulaire : chaque module est un domaine d’activité précis couvrant une partie des chantiers de mise en conformité AI Act. En fonction de vos besoin JEMS vous accompagne de manière ciblée sur vos enjeux réels. Vous activez chaque module à la carte et selon votre calendrier.

- Expertise intégrée : juridique, gouvernance data et ingénierie IA.

- Pilotage budgétaire fluide : charges étalées sur 2025–2026 selon le calendrier réglementaire.

- Livrables concrets : cartographie IA, grille de maturité, roadmap priorisée.

- Gouvernance sur mesure : centralisée, fédérée ou intégrée dans vos pratiques DevOps/MLOps.

JEMS – Compliance & Data & IA

JEMS est le partenaire global de ses clients pour les accompagner de bout en bout sur l’ensemble des chaînes de valeur Data & IA. Nous aidons les entreprises européennes dans l’organisation et la réalisation de leurs programmes de conformité Data & IA. Notre expertise est bâtie sur l’expérience opérationnelle et la réussite de projets complexes de conformité réglementaire (RGPD, BCBS239, Bale IV, Solvency II, IFRS, EMIR, AI Act …). JEMS dispose ainsi de nombreuses références sur des projets de conformité réussis dans des programmes de Data Gouvernance, Data Quality Management, Data Catalogue, Certification Data & IA Factory, RGP et Innovation AI qui nous permettent de vous faire bénéficier de notre expertise sur l’AI Act.

FAQ

Quand l’IA Act entre-t-il en vigueur ?

Entrée en vigueur : août 2024. Obligations progressives entre février 2025 et août 2027.

Quelles pratiques sont interdites ?

Notation sociale, extraction massive de visages, reconnaissance biométrique en temps réel sans autorisation, systèmes d’évaluation des émotions à l’école ou au travail.

Qu’est-ce qu’un système à haut risque ?

Les systèmes utilisés dans l’éducation, l’emploi, la finance, la santé, la justice, ou certains composants de sécurité.

Quelles sanctions en cas de non-conformité ?

Des amendes proportionnées pouvant atteindre plusieurs pourcents du chiffre d’affaires de l’entreprise concernée.

L’IA Act transforme la gestion de l’intelligence artificielle en Europe. Les organisations qui anticipent dès aujourd’hui seront mieux armées face aux contrôles, mais aussi plus crédibles auprès de leurs clients et partenaires. La conformité n’est pas une option : c’est un avantage compétitif.

Avec PATH2AI COMPLIANCE, JEMS propose un accompagnement pragmatique, progressif et centré sur vos cas d’usage pour transformer la contrainte réglementaire en opportunité de structuration et de confiance.