IA Act et finance : quels impacts sur le scoring et l’évaluation des risques ?

Le règlement européen sur l’intelligence artificielle, ou IA Act, est entré en vigueur le 1er août 2024. Il s’agit du premier cadre juridique visant à encadrer l’usage de l’IA selon une logique de gestion des risques. En classant les systèmes d’IA selon leur niveau de dangerosité : du risque inacceptable aux usages à haut risque, l’Union européenne a choisi une approche proportionnée, mais ambitieuse. L’IA Act impact particulièrement la finance , car les usages de l’IA touchent directement aux décisions de crédit, de tarification ou de détection de fraude, avec des conséquences majeures pour les individus et la stabilité économique.

Pour les banques, compagnies d’assurance et acteurs du financement, l’IA Act marque un tournant. Les pratiques de scoring de crédit, d’évaluation des risques d’assurance ou encore de gestion automatisée de la conformité réglementaire figurent explicitement dans la liste des systèmes à haut risque définie par le règlement.

L’enjeu est double : se préparer à de nouvelles obligations de documentation, de gouvernance et de supervision, tout en transformant cette contrainte en levier de confiance auprès des clients. Vous voulez savoir comment l’IA Act va impacter vos activités financières ?

Pourquoi le secteur financier est au cœur de l’IA Act ?

La finance et l’assurance font partie des secteurs les plus réglementés d’Europe, et l’IA Act s’inscrit dans cette continuité. Le règlement identifie comme « à haut risque » les systèmes utilisés pour :

- l’évaluation de la solvabilité et l’octroi de crédits,

- la tarification des assurances vie et santé,

- la gestion de services financiers considérés comme essentiels.

Ces activités ne relèvent pas d’un simple confort technologique : elles déterminent l’accès des citoyens à des ressources vitales comme le logement, la santé ou la retraite.

Toute erreur ou tout biais dans un modèle d’IA peut entraîner des répercussions directes sur la vie des personnes concernées. C’est pourquoi la législation européenne impose aux acteurs financiers des contraintes spécifiques : données de qualité, supervision humaine, transparence et robustesse technique.

L’évaluation des risques en assurance

L’assurance est également au cœur des préoccupations du régulateur. L’usage de l’IA pour tarifer des contrats d’assurance santé ou vie, ou pour détecter les risques de sinistre, est soumis aux mêmes exigences de transparence et de robustesse.

Les compagnies doivent garantir que les données utilisées ne créent pas d’exclusions injustifiées, que les modèles sont expliqués et compréhensibles, et que les assurés disposent de voies de recours en cas de décision automatisée.

La gouvernance des données joue ici un rôle central : l’IA Act exige que les ensembles de données d’entraînement soient représentatifs, pertinents et documentés. L’objectif est d’éviter les biais qui pourraient fragiliser la confiance des assurés dans le système.

Les obligations de conformité de l’IA Act pour les acteurs financiers

L’IA Act distingue les obligations selon le rôle joué dans la chaîne de valeur : fournisseurs de systèmes (développeurs ou concepteurs d’IA) et déployeurs (banques, assurances, gestionnaires d’actifs qui intègrent ces systèmes dans leurs processus).

Pour les fournisseurs, les principales obligations comprennent la conception d’un système de gestion des risques, la documentation technique, l’assurance qualité des données et des modèles, la mise en place de mécanismes de traçabilité et de journalisation.

Pour les déployeurs, les obligations portent notamment sur l’utilisation conforme du système, la conservation de certains journaux, la réalisation, pour certains cas, d’analyses d’impact sur les droits fondamentaux, la supervision humaine des décisions.

Dans le secteur financier, cela signifie que les établissements devront documenter précisément leurs pratiques de scoring ou d’évaluation de risque, et être en mesure de produire ces informations lors d’un contrôle par les autorités compétentes, telles que l’ACPR en France.

Les risques d’une non-conformité

Ne pas se conformer à l’IA Act expose les entreprises financières à plusieurs types de risques :

- réglementaires, avec des amendes pouvant atteindre plusieurs pourcents du chiffre d’affaires de l’entité concernée,

- juridiques, avec des contentieux liés à des décisions perçues comme discriminatoires,

- réputationnels, en cas de mauvaise presse ou de perte de confiance des clients,

- financiers, car le coût d’une mise en conformité tardive peut s’avérer bien plus élevé que celui d’une préparation anticipée.

Comme le rappelle l’ACPR, la conformité au règlement européen sur l’IA doit être considérée non pas comme une charge ponctuelle, mais comme une démarche continue de pilotage des risques et d’amélioration de la qualité des systèmes.

Comment se préparer dès aujourd’hui ?

Pour les établissements financiers, la préparation ne peut pas attendre l’échéance réglementaire de 2026. Trois chantiers apparaissent prioritaires :

- Cartographier les usages d’IA déjà présents dans l’organisation, en identifiant ceux qui relèvent du haut risque.

- Mettre en place une gouvernance des données claire, associant juristes, data scientists, métiers et responsables conformité.

- Développer une documentation technique et organisationnelle qui pourra être utilisée comme preuve en cas de contrôle.

Les entreprises qui anticipent ces étapes disposeront d’un avantage compétitif : elles pourront démontrer leur sérieux à leurs clients, réduire les risques de sanctions et améliorer la robustesse de leurs systèmes. À l’inverse, celles qui tardent risquent de devoir effectuer des mises à niveau coûteuses et précipitées.

Le secteur financier est en première ligne face à l’IA Act. Si cette réglementation représente un effort certain, elle constitue également une opportunité : celle de renforcer la confiance des clients, d’améliorer la qualité des modèles et de réduire les risques juridiques.

L’IA Act n’est pas seulement une contrainte réglementaire : c’est un levier pour bâtir une finance plus transparente, plus équitable et plus résiliente.

FAQ – IA Act et secteur financier

Quand l’IA Act est-il entré en vigueur et quand s’applique-t-il ?

Le règlement est entré en vigueur le 1er août 2024. Les interdictions de certaines pratiques s’appliquent depuis février 2025. Les règles sur les modèles à usage général et la mise en place des autorités nationales sont attendues pour août 2025. Les obligations centrales pour les systèmes à haut risque, dont le scoring de crédit et l’évaluation en assurance, entreront en vigueur en août 2026.

Quelles pratiques financières sont interdites par l’IA Act ?

Le règlement interdit, entre-autres, les systèmes de notation sociale, certaines pratiques de surveillance biométrique de masse ou d’évaluation émotionnelle. Dans la finance, cela concerne surtout les cas où des données personnelles sensibles seraient exploitées de manière abusive.

Qu’est-ce qu’un système d’IA à haut risque dans la finance ?

Sont considérés comme à haut risque : le scoring de crédit, l’évaluation de la solvabilité, la tarification en assurance vie et santé, ainsi que certains usages liés à la détection de fraude ou au contrôle de services essentiels. Ces systèmes doivent répondre à des obligations renforcées de transparence, de supervision et de robustesse.

Quelles sanctions en cas de non-conformité ?

Les sanctions prévues peuvent atteindre plusieurs pourcents du chiffre d’affaires, selon la gravité des manquements. Elles s’ajoutent aux risques réputationnels et juridiques pour les établissements financiers qui ne respecteraient pas le règlement.

Comment une banque ou une compagnie d’assurance peut-elle se préparer ?

La préparation passe par trois étapes clés : cartographier les usages existants, mettre en place une gouvernance des données robuste, et développer une documentation technique et organisationnelle. Anticiper ces démarches dès maintenant permet de lisser les coûts et de renforcer la confiance des clients.

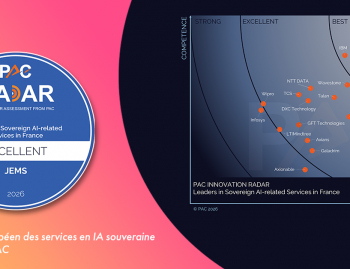

L’offre JEMS PATH2AI COMPLIANCE

Se mettre en conformité avec l’IA Act peut sembler complexe, surtout pour les secteurs critiques comme la finance. Chez JEMS, nous avons conçu PATH2AI COMPLIANCE, une approche pragmatique qui permet de :

- Activer uniquement les briques* dont vous avez besoin, sans démarche lourde.

- Bénéficier d’une expertise intégrée juridique, data et IA

- Obtenir des livrables concrets dès les premières phases : cartographie des usages, grille de maturité, roadmap priorisée.

- Construire une gouvernance IA adaptée à votre organisation, qu’elle soit centralisée, fédérée ou intégrée dans vos pratiques DevOps/MLOps.

*Briques proposées : Audit, Formation, Plan de gouvernance, Cadre normatif, Lignes directrices, Procédures IA, Contrôles & surpervision, Structuration & outils de gouvernance, Platform Governance Raci Risk (GRC), Audit de conformité dédié aux IA génératives…